- 誤答率(error rate)とは何か

- 誤答率(error rate)の具体的な計算方法

誤答率(error rate)とは

誤答率(error rate)とは、

です。

$$error= \frac{間違えたデータ}{全データ}$$で表されます。

間違えて予測したものは混合行列でいうと偽陽性(偽物を本物と予測したもの)と偽陰性(本物を偽物と予測したもの)です。

つまり誤答率(error rate)は以下の式で表すことができます。

$$error= \frac{間違えたデータ}{全データ}=\frac{FP+FN}{TP+TN+FP+FN} $$

混合行列が分からない場合はこちらの記事で解説しているので、読んでみてください。

誤答率(error rate)を実際に計算してみる

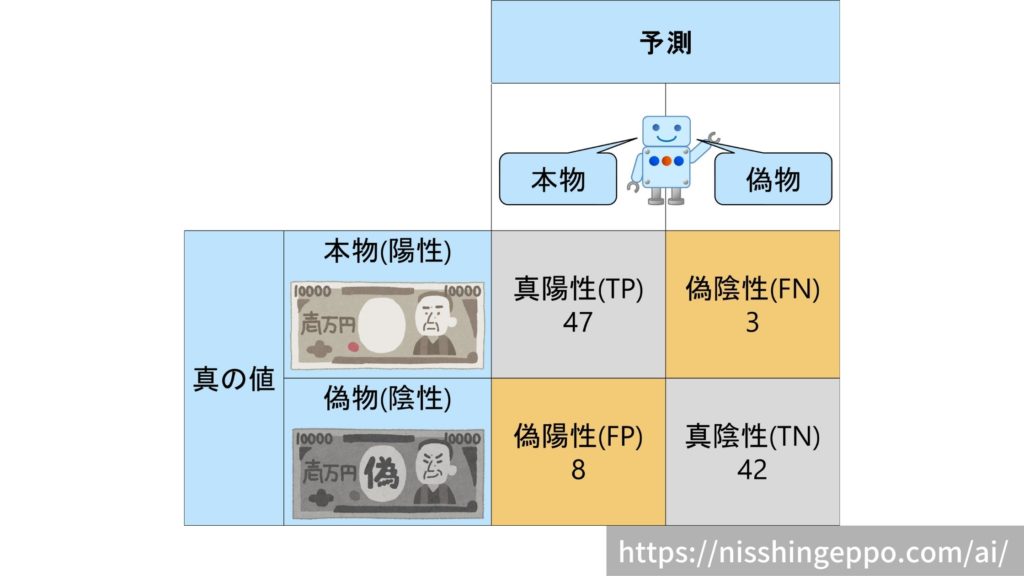

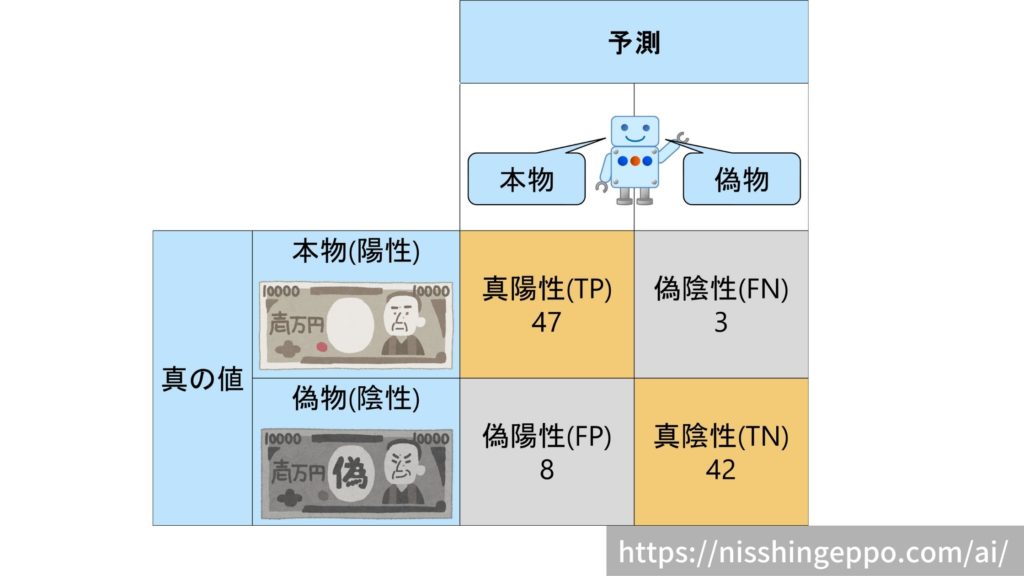

本物のお札50枚と偽物のお札50枚の計100枚のお札を判定する例を考えてみます。

偽物を本物として誤って判断した(FP)が8枚、本物を偽物として誤って判断したもの(FN)が3枚です。

これらの合計の11枚が間違えたものとなります。

そのため、

$$error= \frac{FP+FN}{TP+TN+FP+FN} = \frac{8+3}{47+42+8+3}=0.11 $$

となり、誤答率(error rate)は0.11(11%)です。

データが偏っていると正しく評価しづらい

誤答率(error rate)は不均衡なデータ(陽性が90%など)の場合、正しく評価し辛くなります。

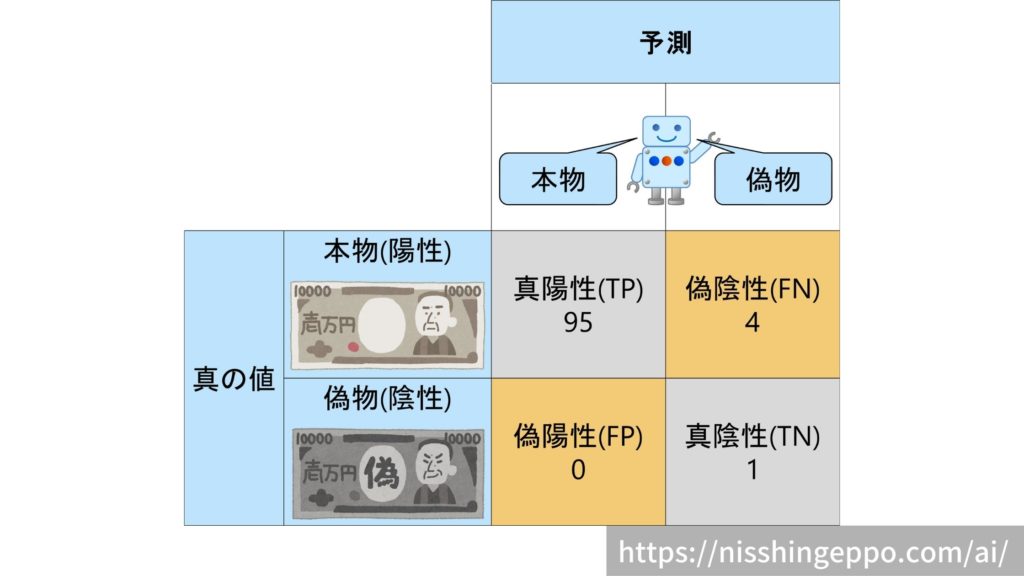

例えば、本物が99枚、偽物が1枚の計100枚のお札をAIで分類したときの例を考えてみましょう。

このときの誤答率(error rate)は、

$$error= \frac{FP+FN}{TP+TN+FP+FN} = \frac{0+4}{95+4+0+1}=0.04 $$

となり、誤答率(error rate)は0.04(4%)です。

一見きちんと評価できているように見えます。

ここで、どんなデータであっても本物と判断するAIについても正解率を計算してみましょう。

$$error= \frac{FP+FN}{TP+TN+FP+FN} = \frac{1+0}{99+0+1+0}=0.01 $$

となり、誤答率(error rate)は0.01(1%)です。

何も考えずに本物と判断するAI(偽札を一切見抜けないAI)の方が優れているという結果になってしまいました。

このように偏ったデータから算出した誤答率だけでAIの良し悪しを検討すると、目的に合わない判断をしてしまうことがあります。

まとめ

誤答率(error rate)とは、混同行列を使った評価指標の1つで、AIが誤った予測をした割合(全体の何%を間違えたのか)を表す評価指標です。

$$error= \frac{間違えたデータ}{全データ}$$で表されます。

また、1-正解率(Accuracy)でも求めることができます。

誤答率(error rate)は不均衡なデータ(陽性が90%など)の場合、正しく評価し辛くなります。

コメント